Lea - l'IA qui rééduque les trolls et vous bannit d'Internet

Édit : alors même si c’était un poisson d’avril, j’avoue que j’aimerais bien que cette extension existe. Merci à tous ceux qui ont joué le jeu ! Et à l’année prochaine pour un poisson d’avril, encore plus pourri. !!

Si vous avez une opinion sur tout et surtout une opinion et que vous ne pouvez pas vous empêcher de déclencher des guerres dans les commentaires et sur les réseaux sociaux où vous sévissez, alors cet article est pour vous !

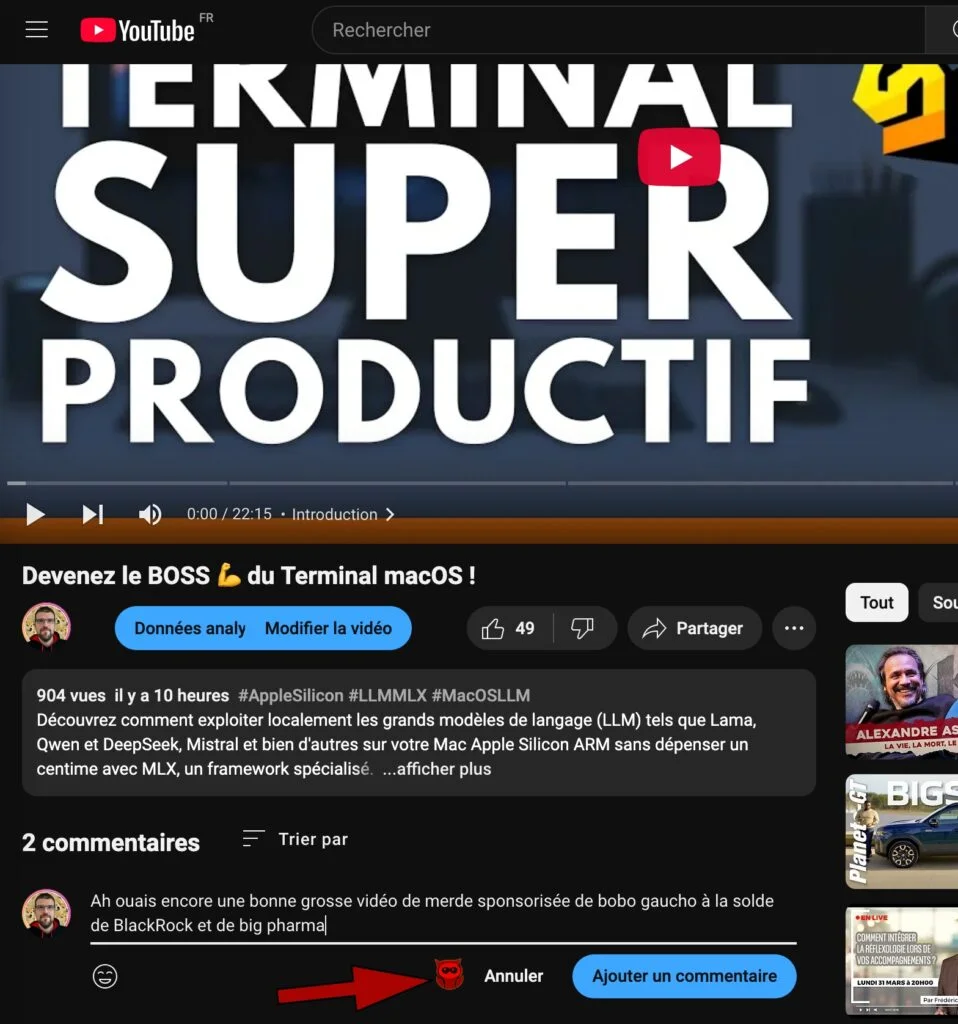

Vous adorez par exemple partager l’immense vacuité de votre réflexion de manière passive-agressive, voire agressive tout court. Ou tout simplement vous êtes ce type de personne qui commente une vidéo clairement étiquetée comme sponsorisée pour signaler… qu’elle est sponsorisée. Ou qui demande dans les commentaires une information explicitement mentionnée dans l’article que vous n’avez visiblement pas lu.

Bref, vous êtes un ou une grosse relou(e). Mais vos jours sont comptés car une nouvelle extension Chrome / Firefox va mettre un terme à votre carrière de provocateur idiocrate ! Une solution radicale pour nettoyer nos espaces numériques et rendre Internet à nouveau respirable. Ouf, j’en rêvais !

Cela s’appelle Lea, et c’est développé par EthicalByte, une mystérieuse start-up californienne fondée par d’anciens de la Silicon Valley apparemment traumatisés par les sections commentaires. Et ça tombe bien car leur date de lancement, c’est aujourd’hui même, en ce premier jour du quatrième mois de l’année !

Une fois installée dans votre navigateur, Lea devient alors la conscience que vous n’avez jamais eue, surtout quand c’est sur le net et qu’il n’y a personne en face de vous pour vous casser la gueule.

Cet outil utilise une intelligence artificielle entraînée spécialement sur pas moins de 15 millions de conversations en ligne, soigneusement catégorisées selon leur niveau de toxicité. C’est comme si on avait fait lire tous les commentaires de YouTube à un algorithme et qu’on lui avait dit “fais EXACTEMENT l’inverse de ça”.

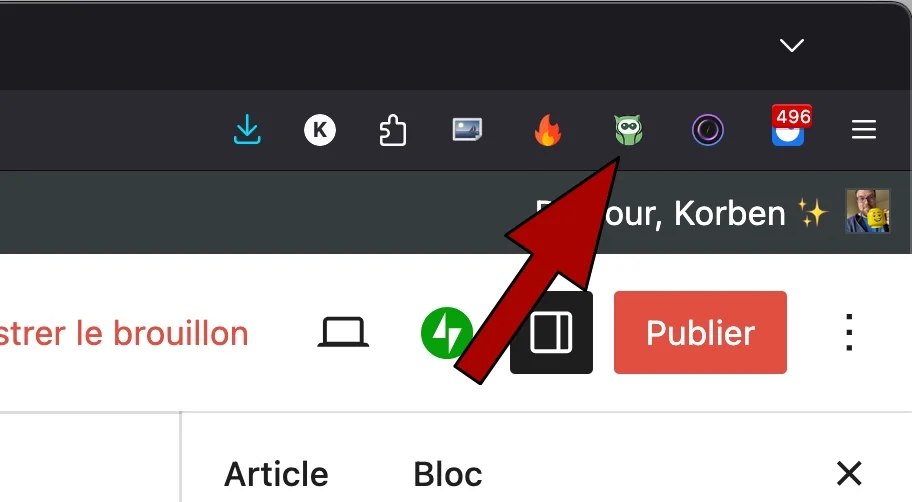

Et celle-ci a une particularité technique impressionnante : tout fonctionne en local grâce à un modèle de LLM compressé de 1,2 Go ce qui fait que vos données ne sont pas envoyées sur des serveurs tiers. Cette IA analyse alors en temps réel absolument tout ce que vous tapez dans les champs de texte de votre navigateur. TOUT. Oui, même ce message privé légèrement passif-agressif que vous êtes en train d’envoyer à votre collègue.

Lea utilise un système de reconnaissance de patterns lexicaux associé à une analyse contextuelle qui lui permet ainsi de distinguer une critique constructive d’une attaque personnelle déguisée. Elle est capable de détecter 8 types de comportements problématiques :

- L’agressivité (votre spécialité quand on critique votre série préférée)

- Le sarcasme excessif (un péché mignon, il faut l’avouer)

- Les insultes voilées (celles que vous pensiez subtiles)

- La désinformation (non, ce n’est pas parce que tu l’as lu sur Twitter, Roger, que c’est vrai !)

- La critique non constructive ("c’est nul" n’est pas un avis élaboré)

- Les propos discriminatoires (on ne vous fait pas un dessin)

- La manipulation émotionnelle (vos techniques de culpabilisation ne passeront plus ! ché !)

- Et les rumeurs non fondées (vos théories du complot préférées)

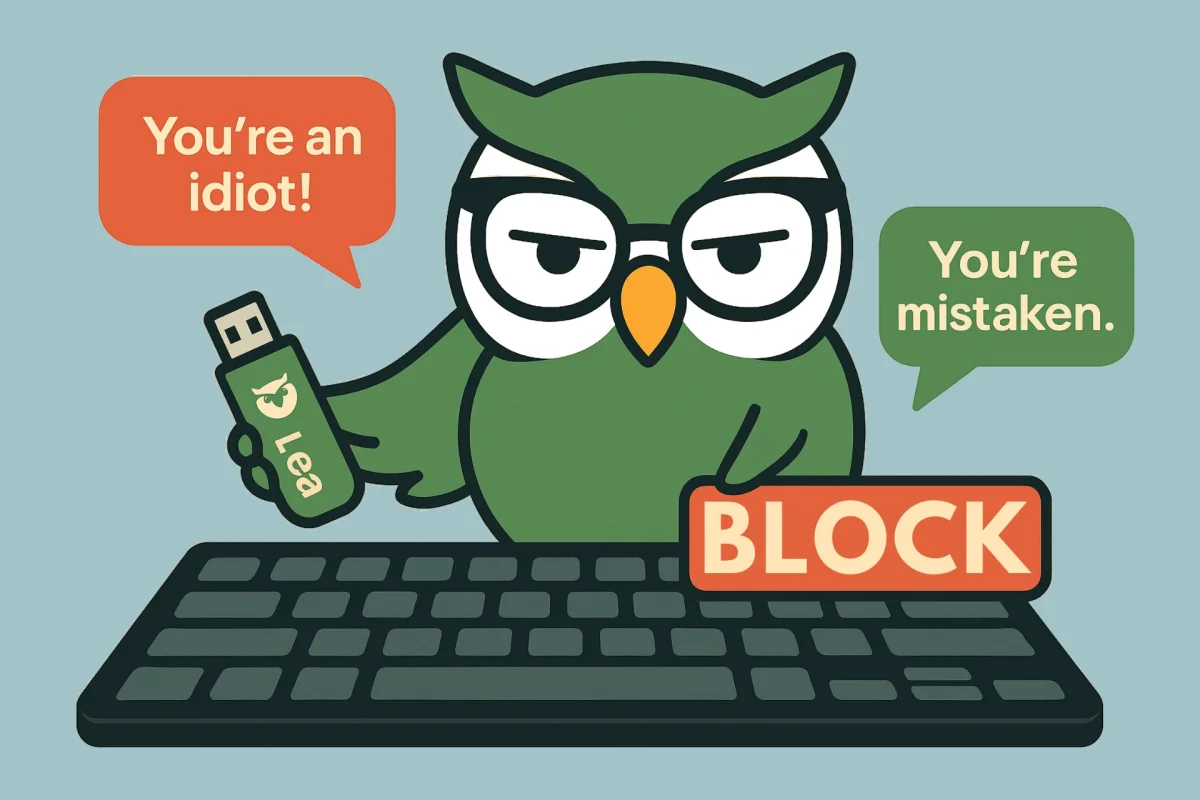

L’extension se matérialise par un petit avatar en forme de chouette à lunettes qui apparaît dans le coin de chaque champ texte. Cet adorable volatile change de couleur selon la toxicité de votre prose : vert quand vous êtes un citoyen modèle, orange quand vous commencez à dériver, et rouge quand vous redevenez le troll que vous essayez de ne plus être.

En mode “coach” (activé par défaut), Lea se contente gentiment de suggérer des reformulations en temps réel.

Par exemple, si vous écrivez : “Cet article est complètement stupide, t’as changé Korben… et pas en bien ! Je me désabonne !” Lea corrigera comme ceci : “Cet article ne répond pas à mes attentes et j’espère que Korben pourra l’améliorer.”

Vous voyez ? C’est quasiment la même chose, mais en moins… vous.

Là où ça devient vraiment intéressant (ou terrifiant, selon votre point de vue), c’est avec les modes plus avancés. En mode “gardien”, Lea peut ainsi carrément bloquer l’envoi de messages jugés inappropriés.

Imaginez, vous venez de passer 15 minutes à rédiger une réponse cinglante à un commentaire politique qui vous a déclenché comme d’hab une petite rage d’enfant de 5 ans, et au moment de cliquer sur “Envoyer”… rien. Juste une petite chouette qui secoue la tête d’un air désapprobateur.

Mais le summum du contrôle comportemental, c’est le mode “réformateur”. Non seulement Lea analyse ce que vous êtes en train d’écrire, mais elle examine également l’historique de vos messages et même votre bio. Si elle détecte un pattern de toxicité, elle peut alors vous imposer une pause forcée. Ces temps de pénitence numérique commencent à partir de 15 minutes et augmentent de façon exponentielle : 30 min, 1h, 2h, 4h… jusqu’à potentiellement 7 jours d’exclusion si vous êtes un cas désespéré.

Voici comment fonctionne concrètement le mode réformateur :

- Analyse complète de votre empreinte numérique

- Calcul d’un score initial basé sur vos 100 derniers messages

- Surveillance continue de vos nouvelles interactions

- Application de pénalités progressives selon la gravité des infractions

- Verrouillage de l’extension pendant les périodes de bannissement

Tout ce système repose sur un “score de civilité” invisible allant de 0 à 100.

Chaque message problématique fait baisser ce score, et les blocages commencent quand vous descendez sous la barre des 50 points. Un simple “c’est nul” vous coûte 2 points, une insulte directe 10 points, et une menace voilée peut vous faire perdre jusqu’à 25 points d’un coup.

Lors de mon test, j’ai perdu 15 points en critiquant un peu trop vivement Elon Musk sur BlueSky, puis 20 autres en m’emportant dans une discussion sur Youtube au sujet de l’usage de l’IA générative notamment pour faire des images dans le style de Ghibli. Le plus pervers c’est que l’extension devient impossible à désinstaller pendant un blocage actif. EthicalByte a vraiment pensé à tout.

Pour enfoncer le clou, Lea synchronise votre score entre tous vos appareils via votre compte Google / Firefox. Comme ça, c’est même pas la peine de changer d’ordinateur pour contourner votre punition. Et pour les plus accros du contrôle comportemental, une version premium (annoncée à 5,99€/mois) propose un “certificat de bienveillance” à partager sur vos réseaux sociaux.

“Regardez, je ne suis plus le monstre que j’étais avant !”

J’en connais à qui ça sera utile !

Des partenariats seraient même en cours de négociation avec LinkedIn, X et Discord pour intégrer ce certificat directement dans les profils.

D’après une étude menée sur 2500 beta-testeurs pendant 45 jours, l’utilisation de Lea aurait entraîné une réduction de 71% des messages signalés comme inappropriés et une amélioration de 54% dans la qualité perçue des interactions en ligne. Plus impressionnant encore, 82% des testeurs admettent avoir modifié leur comportement même sur des plateformes où l’extension n’est pas active.

Alors au début, je croyais que cette extension était une atteinte à ma liberté d’expression, mais j’ai réalisé que je confondais liberté et toxicité. Maintenant, mes interactions sont plus constructives, et bizarrement, les gens me répondent plus positivement donc je trouve ça cool.

Une grande entreprise tech envisage même de rendre Lea obligatoire pour tous ses employés sur leurs postes professionnels, y compris pour les communications internes sur Slack et Microsoft Teams. Passer par un peu de surveillance au travail pour combattre la toxicité sur les réseaux, c’est un moindre mal je trouve.

La prochaine mise à jour de Lea prévoirait même d’ajouter une fonction d’analyse vocale pour les conversations Discord et les réunions Zoom. Imaginez votre micro se coupant automatiquement quand vous commencez à vous énerver pendant une réunion d’équipe…

Bien sûr, ce genre d’outil soulève des questions fondamentales sur l’équilibre entre liberté d’expression et responsabilité en ligne. Est-ce que nous avons besoin d’une IA pour nous forcer à être polis, gentils et bienveillants ? Est-ce que les critères de jugement de cette IA sont objectifs ou reproduisent-ils des biais ? L’autocensure constante est-elle vraiment saine pour notre santé mentale ? Et est-ce que cela ne va pas au contraire isoler encore plus les gens fondamentalement mauvais qui pourraient alors exprimer pleinement leur toxicité IRL plutôt que d’utiliser Internet et son côté virtuel comme échappatoire lorsqu’ils font des crises de méchanceté ?

Voilà, si vous êtes curieux de découvrir à quel point vous êtes toxique en ligne (spoiler : probablement plus que vous ne le pensez), tentez l’expérience. Mais attention, une fois installée, Lea ne vous lâchera plus, comme un poisson mordant à l’hameçon…