Pendant qu’une utopie où les véhicules autonomes, les assistants virtuels et les systèmes de recommandation se profile à l’horizon, force est de constater que l’intelligence artificielle n’en est encore qu’à ses balbutiements. La promesse d’un monde meilleur se heurte à la dure réalité des incidents causés par ces systèmes dits « intelligents », déployés trop rapidement dans notre environnement.

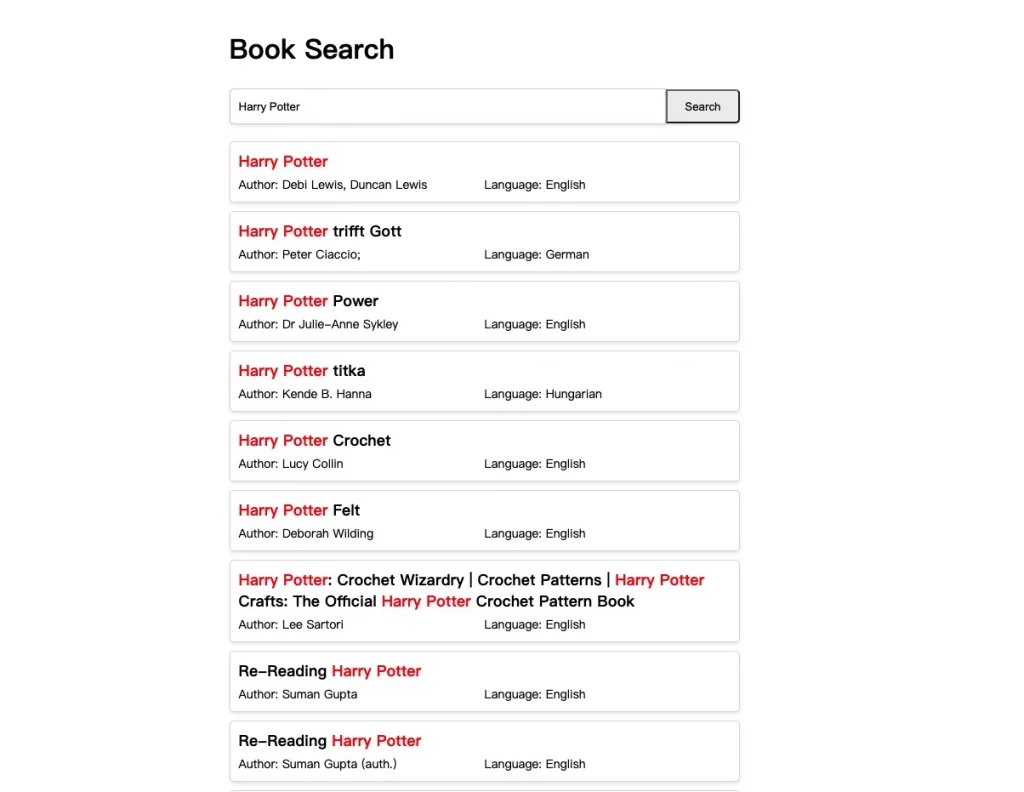

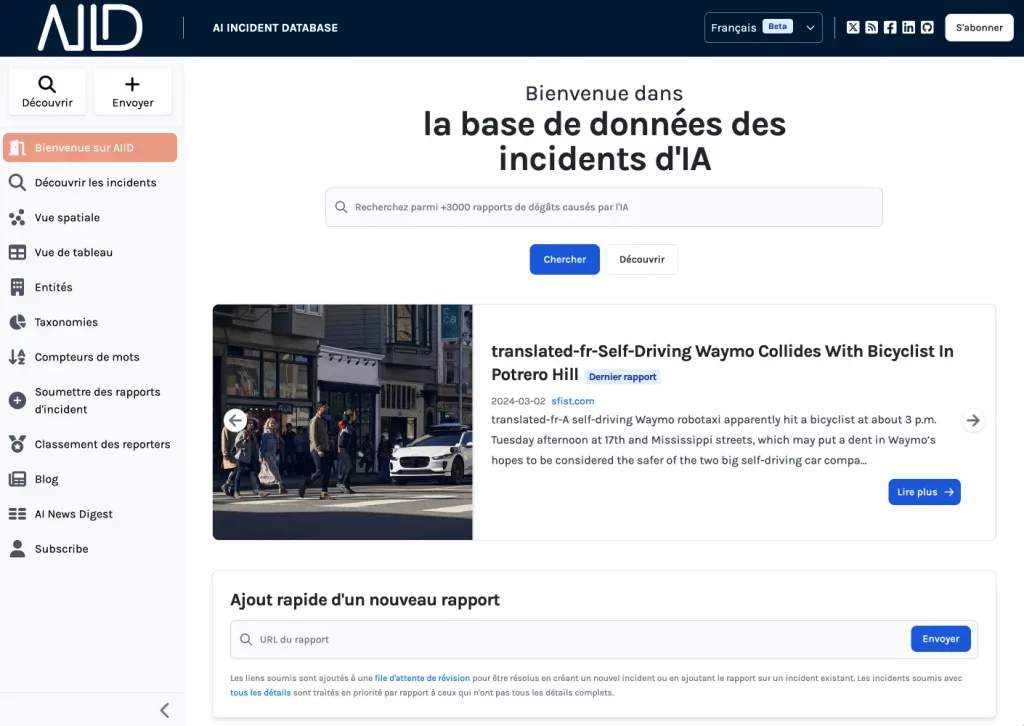

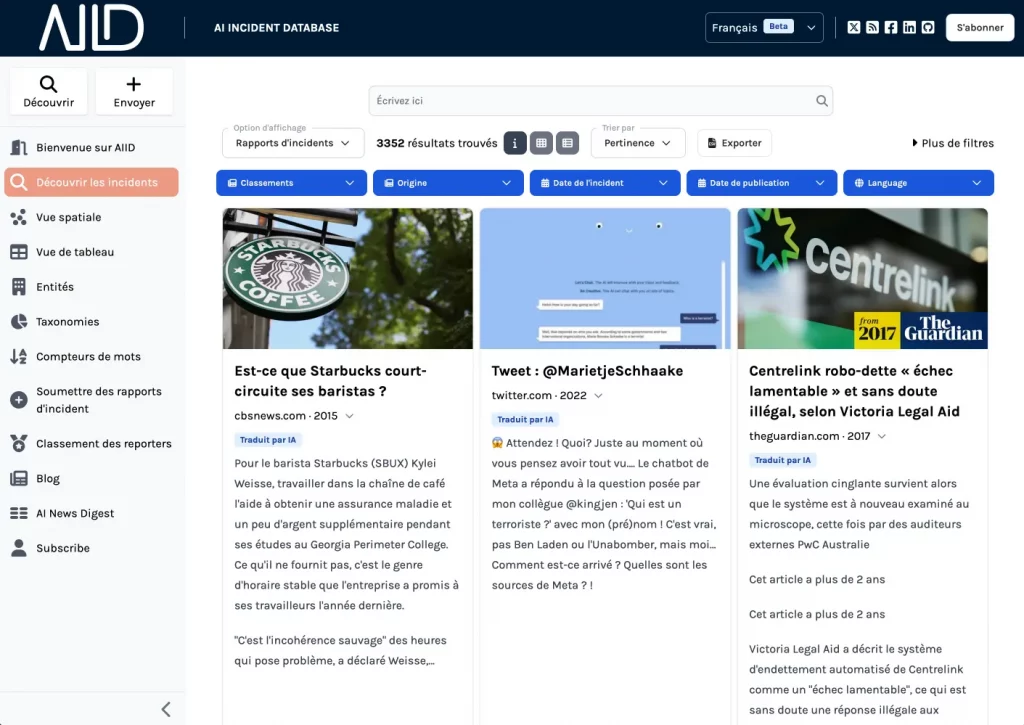

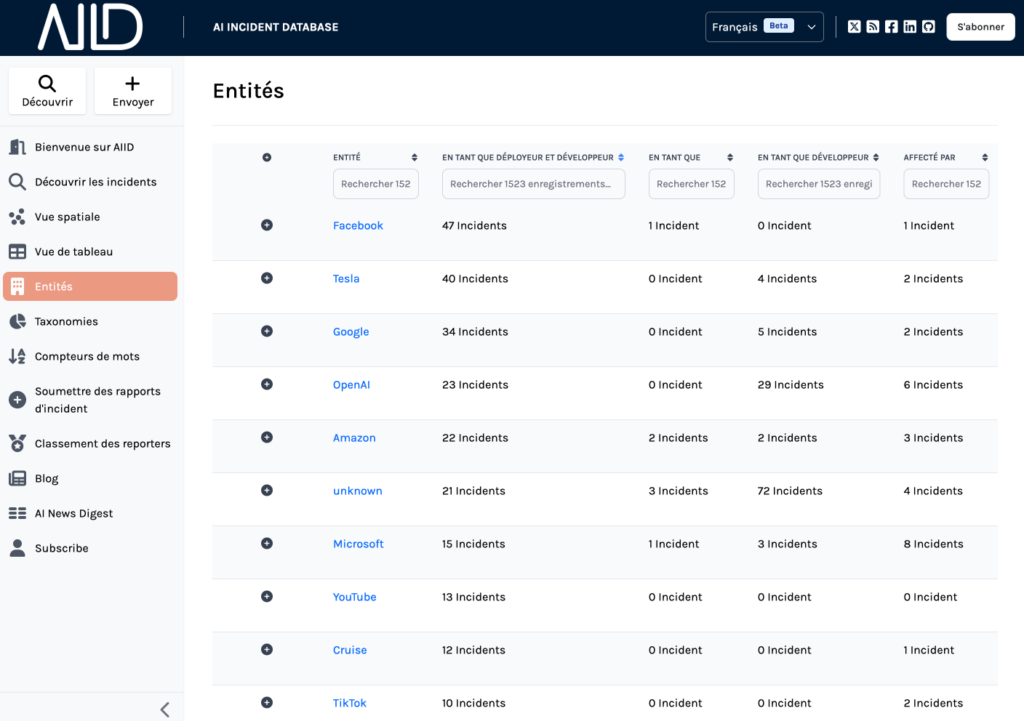

C’est là qu’intervient la base de données des incidents d’IA (AIID), véritable mémoire collective répertoriant les bugs, plantages et autres dérapages de l’IA lorsqu’elle est lâchée dans la nature. Tel un Guinness Book des foirages technologiques, elle recense déjà plus de 1000 cas, des plus anodins aux plus tragiques :

- – un taxi sans chauffeur Waymo qui emboutit un cycliste en plein San Francisco

- – un deepfake audio d’Imran Khan appelant au boycott des élections au Pakistan pour tromper les électeurs

- – de fausses images de Donald Trump entouré d’électeurs noirs générées par IA pour influencer le vote des afro-américains

- – et le pire de tous (ou pas) : des collégiens de Beverly Hills qui créent de fausses photos dénudées de leurs camarades grâce à l’IA !

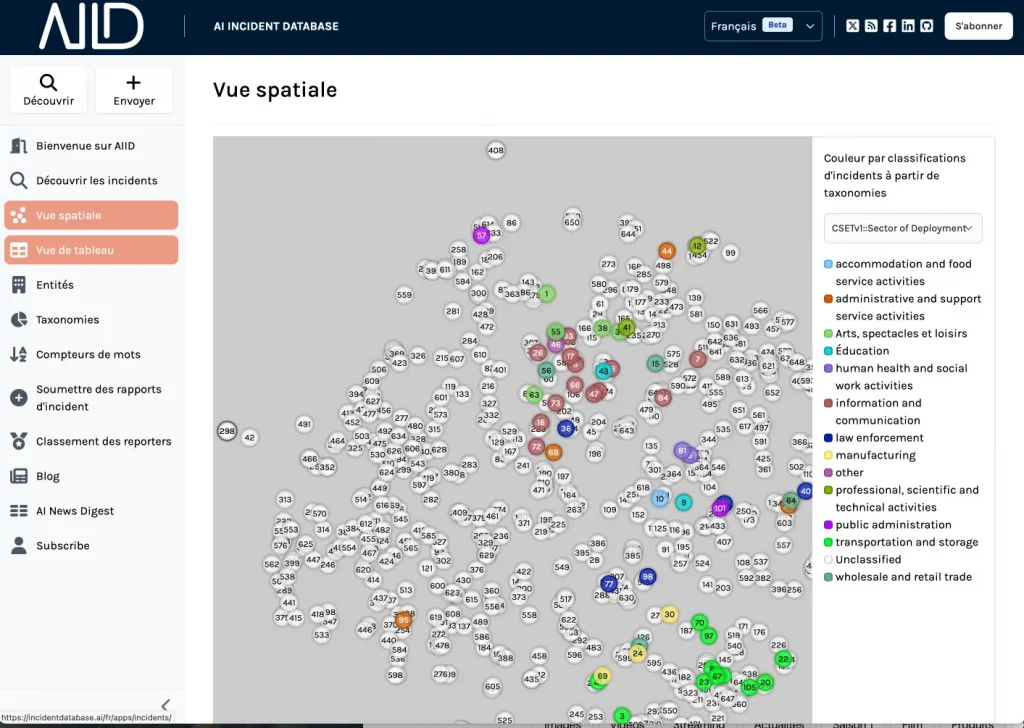

Bref, c’est la foire aux casseroles dans le merveilleux monde de l’IA et il était temps que quelqu’un dresse l’inventaire de ces dérapages en tout genre. Mais au-delà du simple folklore, la mission de l’AIID est d’apprendre de ces échecs pour bâtir des IA plus sûres, à l’image de ce qui se fait dans l’aéronautique ou la cybersécurité.

La base s’enrichit chaque jour grâce aux signalements de la communauté. Chacun peut ainsi apporter sa pierre à l’édifice en soumettant de nouveaux incidents, triés et classés pour en dégager des tendances. L’idée est d’arriver à une définition partagée de ce qu’est un « incident d’IA » et d’en tirer des leçons pour l’avenir.

Car n’en déplaise à Elon Musk ou à Mark Zuckerberg, le futur de l’IA ne se fera pas sans règles ni garde-fous. Pour que la révolution intelligente profite au plus grand nombre, elle doit impérativement s’accompagner d’une démarche éthique et responsable. C’est précisément la mission du Responsible AI Collaborative, l’organisation derrière l’AIID, qui rassemble chercheurs, entrepreneurs et experts du monde entier.

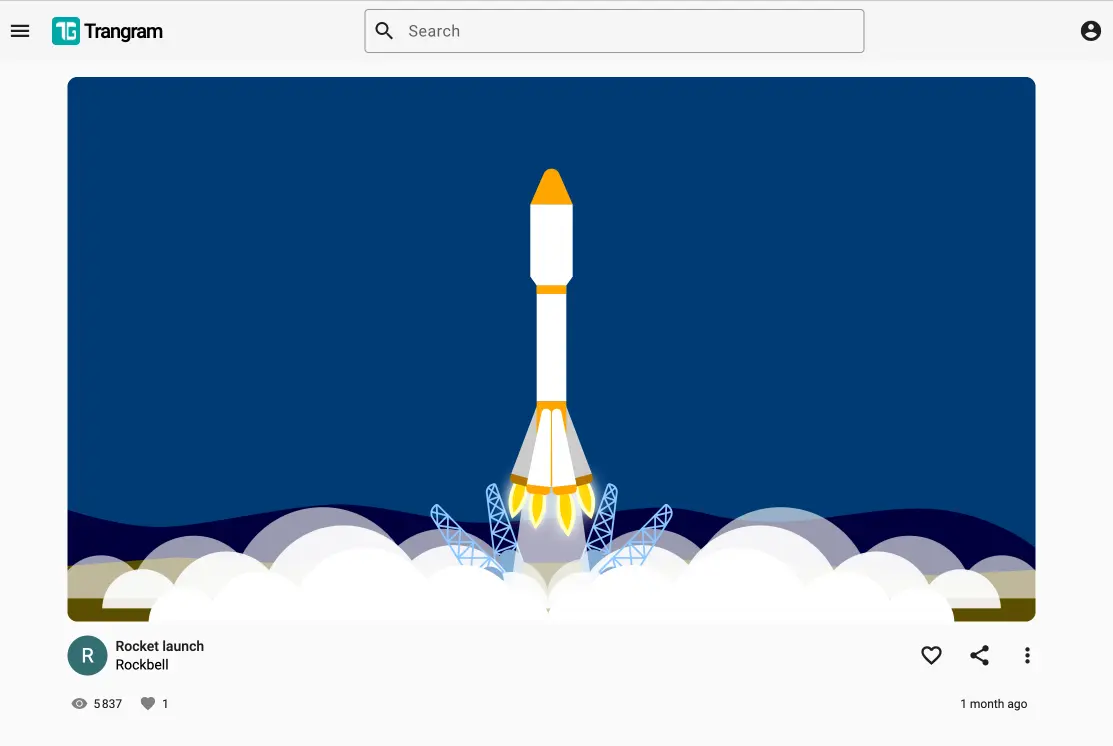

D’ailleurs, vous aussi, vous pouvez contribuer ! Et ils ont de grandes ambitions puisque la prochaine étape sera d’intégrer les incidents dans des outils de test pour reproduire les scénarios à risque et s’entraîner à y faire face. Une sorte de « crash test » géant pour IA en quelque sorte !

À terme, l’objectif est de faire de l’AIID un outil incontournable pour tous les acteurs de l’écosystème : Chercheurs, régulateurs, industriels… Car ne nous y trompons pas, la course à l’IA ne fait que commencer et les incidents risquent de se multiplier si nous n’y prenons pas garde.

D’ici là, votre mission si vous l’acceptez sera de garder un oeil sur ce grand capharnaüm de l’IA et de signaler sans relâche les anomalies que vous constaterez ! Car après tout, la sécurité de ces systèmes est l’affaire de tous et rien ne vaut la vigilance humaine pour déjouer les bugs les plus retors.