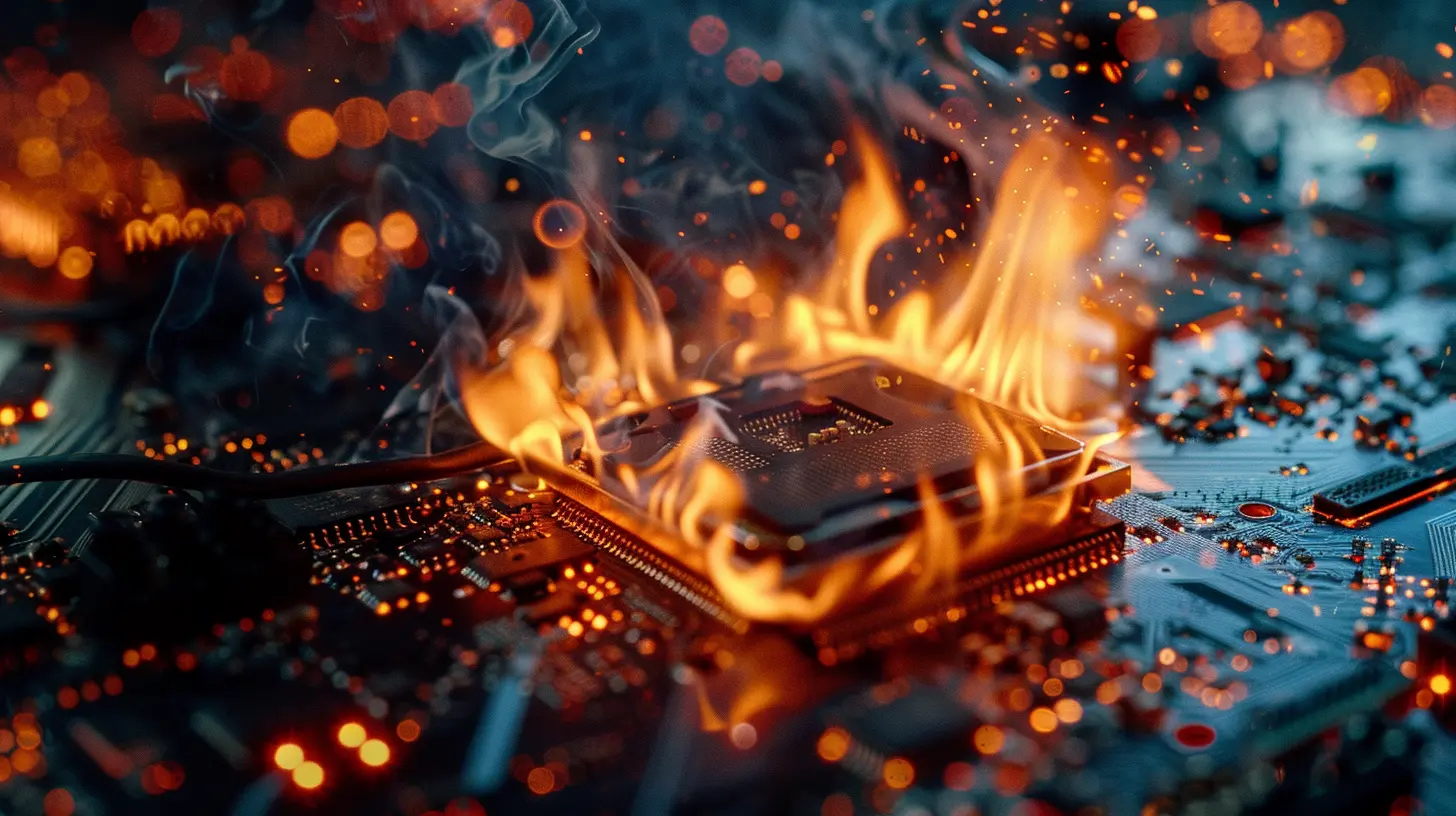

Accrochez-vous bien à vos chaises (ou à vos hamacs, je ne juge pas 😉) car des chercheurs en sécurité nous ont encore pondu une nouvelle attaque qui devrait bien faire stresser sur la sécurité de vos CPU !

Oui je sais, on en a déjà vu des vertes et des pas mûres avec Spectre, Meltdown et toute la clique… Mais là, c’est tout aussi lourd. Ça s’appelle GhostRace et ça va vous hanter jusque dans vos cauchemars !

En gros, c’est une variante de Spectre qui arrive à contourner toutes les protections logicielles contre les race conditions. Les mecs de chez IBM et de l’université d’Amsterdam ont donc trouvé un moyen d’exploiter l’exécution spéculative des processeurs (le truc qui leur permet de deviner et d’exécuter les instructions à l’avance) pour court-circuiter les fameux mutex et autres spinlocks qui sont censés empêcher que plusieurs processus accèdent en même temps à une ressource partagée.

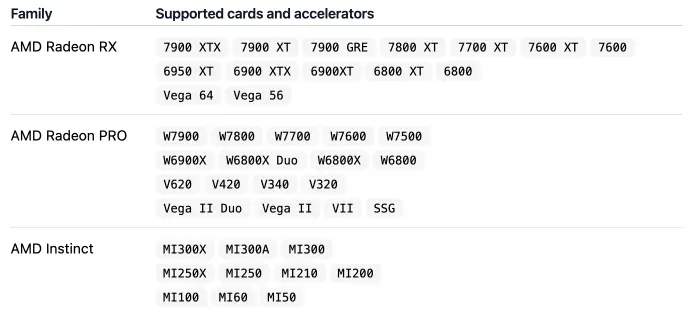

Résultat des courses: les attaquants peuvent provoquer des race conditions de manière spéculative et en profiter pour fouiner dans la mémoire et chopper des données sensibles ! C’est vicieux… En plus de ça, l’attaque fonctionne sur tous les processeurs connus (Intel, AMD, ARM, IBM) et sur n’importe quel OS ou hyperviseur qui utilise ce genre de primitives de synchronisation. Donc en gros, personne n’est à l’abri !

Les chercheurs ont même créé un scanner qui leur a permis de trouver plus de 1200 failles potentielles rien que dans le noyau Linux. Et leur PoC arrive à siphonner la mémoire utilisée par le kernel à la vitesse de 12 Ko/s. Bon après, faut quand même un accès local pour exploiter tout ça, mais quand même, ça la fout mal…

Bref, c’est la grosse panique chez les fabricants de CPU et les éditeurs de systèmes qui sont tous en train de se renvoyer la balle façon ping-pong. 🏓 Les premiers disent « mettez à jour vos OS« , les seconds répondent « patchez d’abord vos CPU !« . En attendant, c’est nous qui trinquons hein…

Mais y’a quand même une lueur d’espoir: les chercheurs ont aussi proposé une solution pour « mitiger » le problème. Ça consiste à ajouter des instructions de sérialisation dans toutes les primitives de synchronisation vulnérables. Bon ok, ça a un coût en perfs (5% sur LMBench quand même) mais au moins ça colmate les brèches. Reste plus qu’à convaincre Linus Torvalds et sa bande de l’implémenter maintenant… 😒

En attendant, je vous conseille de garder l’œil sur les mises à jour de sécurité de votre OS et de votre microcode, on sait jamais ! Et si vous voulez en savoir plus sur les dessous techniques de l’attaque, jetez un œil au white paper et au blog des chercheurs, c’est passionnant.

A la prochaine pour de nouvelles (més)aventures !